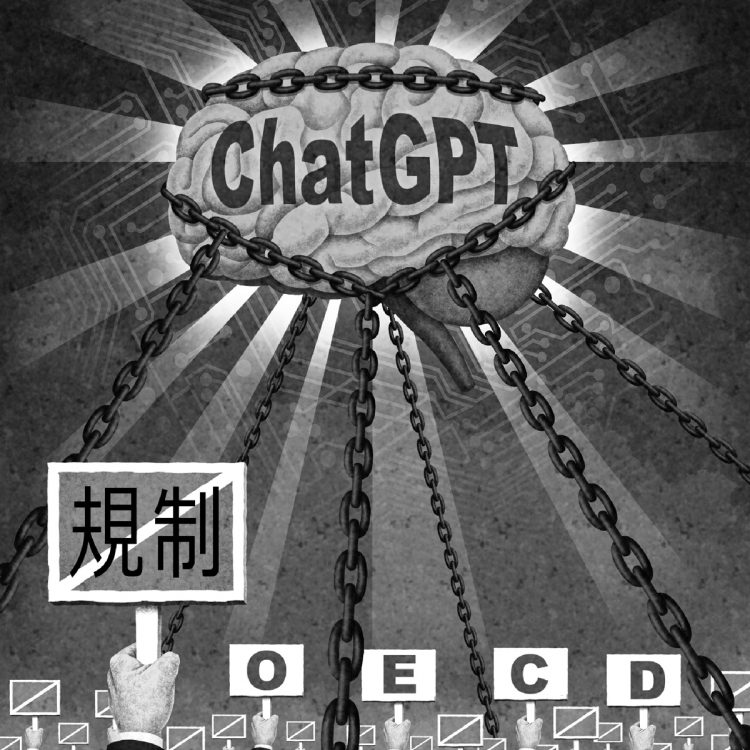

技術革新が続くAIとどう付き合っていけばよいのか(イラスト/井川泰年)

対話型AI(人工知能)「ChatGPT」を巡り、世界的に規制強化の動きが広がっている。4月末に開かれたG7(先進7か国)デジタル・技術相会合の閣僚宣言では、「責任あるAIとAIガバナンスの推進」に向けてG7が議論を続けることを確認した。進化するAIにどのようなリスクがあり、どう付き合っていけばよいのだろうか。経営コンサルタントの大前研一氏が解説する。

* * *

これから人間はAIとどのように付き合っていけばよいのか? 日本では、根拠のない楽観論が大勢を占めているが、警戒すべき点は大きく3つある。

まず、戦争・軍事面での悪用だ。すでにアメリカのソフトウェア企業「パランティア・テクノロジーズ」のAI対応オペレーティングシステムは、アメリカ政府の情報機関(USIC)や国防総省(ペンタゴン)のテロ対策をはじめとする世界の情報・防衛機関などに使用され、ウクライナ軍の対ロシア戦でも威力を発揮しているという。しかし、もしそれがアルカイダやIS(イスラム国)などの国際テロ組織に悪用されたら、世界は大混乱しかねない。

次は、選挙に悪用されることだ。2016年のアメリカ大統領選挙では、ドナルド・トランプ前大統領陣営がイギリスの選挙コンサルティング会社「ケンブリッジ・アナリティカ」を使い、対抗馬のヒラリー・クリントン元国務長官に対する虚偽の誹謗中傷をバラ撒いて選挙活動が有利になるように画策したとされる。

その手法は、不正入手したフェイスブックなどの個人情報からAIによる詳細な心理的プロファイリングで有権者を選別し、政治広告を出し分けてトランプ側に誘導するというものだった。それと同じように、AIを悪用したディスインフォメーションで有権者を騙して当選することが可能になったら、選挙そのものが成り立たなくなる。

最後は工業社会での悪用だ。自動運転車や原子力発電所、建設現場のクレーン、エレベーターなどコンピューターで制御されているすべての工業製品は、ハッカーがAIを使って事故を引き起こす恐れがある。

以上3つは現在進行形の現実的な脅威であり、世界にとって喫緊の課題だが、その一方で対話型AIは省力化・効率化の革命的なツールだから開発の中断はあり得ない。人類の歴史は技術革新の歴史であり、それを止めることは不可能だ。